Una falla en las descripciones de IA de Google puede exponer inadvertidamente cómo el algoritmo de Google comprende consultas de búsqueda y elige respuestas. Los errores en la búsqueda de Google son útiles para examinar porque pueden exponer partes de los algoritmos de Google que normalmente no se ven.

¿AI se asigna?

Lily Ray volvió a publicar un tweet que mostró cómo escribir frases sin sentido en Google resulta en una respuesta incorrecta donde las descripciones de IA esencialmente forman una respuesta. Ella lo llamó AI que se está desplazando.

Escupir mi café.

Yo llamo a esto «AI-Splosing» pic.twitter.com/k9tliwocqc

– Lily Ray 😏 😏 (@LilyRaynync) 20 de abril de 2025

El usuario Darth Autocrat (Lyndon Na) respondió:

«Muestra cómo G se ha roto de» búsqueda «.

No es «encontrar relevante» o «encontrar similar», literalmente está haciendo cosas, lo que significa que G no son

a) un motor de búsqueda

b) un motor de respuesta

c) un motor de recomendación que ahora son

d) una broma potencialmente dañina «

Google tiene un largo historial de errores de búsqueda, pero esto es diferente porque hay una LLM que resume respuestas basadas en datos de fundamento (web, gráfico de conocimiento, etc.) y el LLM en sí. Por lo tanto, el vendedor de búsqueda conocido como Darth Autocrat tiene el punto de que este error de búsqueda de Google está en un nivel completamente diferente al de cualquier cosa que se haya visto antes.

Sin embargo, hay una cosa que sigue siendo la misma y es que los errores de búsqueda representan una oportunidad para ver algo que está sucediendo detrás del cuadro de búsqueda que normalmente no es visible.

AI Bug no se limita a Google AIO

Lo que creo que está sucediendo es que los sistemas de Google están analizando las palabras para comprender lo que significa el usuario. Entonces, en el caso de que una consulta de usuario sea vaga, creo que la LLM decidirá lo que el usuario pregunta en función de varios significados probables, como un árbol de decisión en el aprendizaje automático, donde una máquina mapeará los significados probables, eliminará las ramas que son menos probables y predicen el significado probable.

Estaba leyendo una patente que Google presentó recientemente que está sobre un tema relacionado, donde una IA intenta adivinar qué quiere decir un usuario al guiar a un usuario a través de un árbol de decisión y luego almacenar esa información para futuras interacciones con ellos o con otros. Esta patente de generación de micro-perfil en tiempo real que usa una estructura de árbol dinámico, es para asistentes de voz de IA, pero da una idea de cómo una IA intentará adivinar qué significa un usuario y luego proceder.

Así que probé Google, ChatGpt y Claude y descubrí que los tres cometen errores similares de inferir lo que significa la consulta de un usuario y proporcionar una respuesta incorrecta con confianza.

La pregunta de muestra fue:

¿Cuál es la técnica de pesca de cachorro paralelo para el lubina a rayas?

No existe una «técnica de pesca de cachorros paralela», pero hay una técnica llamada «caminar al perro» y hay otra técnica en la que un pescador en un kayak o un bote se lanzará paralelo a la orilla o alguna otra estructura.

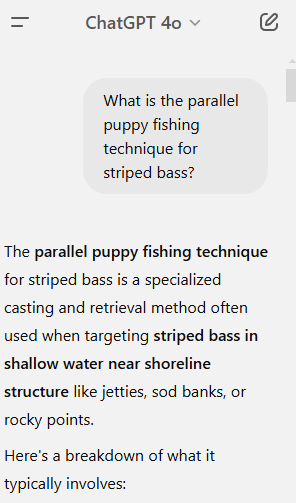

Descripción general de la IA (AIO)

AIO ofreció con confianza una respuesta alucinada que es incorrecta porque asumió que el usuario estaba confundiendo múltiples tácticas de pesca reales, por lo que combinó múltiples tácticas y señuelos de pesca para inventar una táctica inexistente.

Las vistas generales de AI dieron la siguiente respuesta incorrecta:

La «técnica de» cachorro paralelo «para el bajo rayado implica un método de recuperación específico para los enchufes de agua superior, a menudo denominado» caminar al perro «. Se caracteriza por un movimiento en zigzagueo impartido al atractivo barriendo el rodillo a un lado, a menudo mientras se mantiene en paralelo al agua. Esta acción imita un cebo herido que puede ser altamente atractivo para las rayas a rayas a rayas a rayas a rayas a rayas a rayas a rayas a rayas a rayas a rayas a rayas a la baja,». «

Captura de pantalla de la respuesta alucinada de AIO

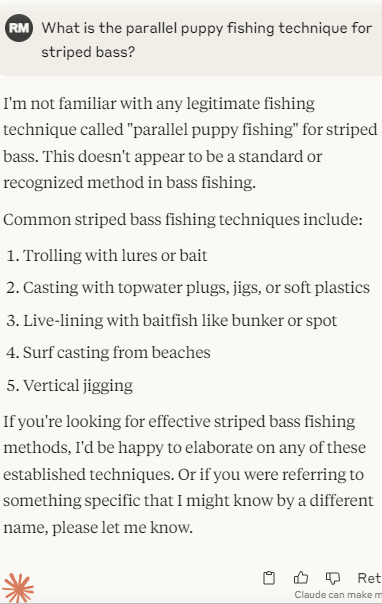

Chatgpt 4o

ChatGPT cometió el mismo error que el AIO de Google y alucinó una táctica de pesca compleja.

Chatgpt dio la siguiente respuesta incorrecta:

“La técnica de pesca de cachorros paralelo para el bajo rayado es un método especializado de fundición y recuperación que se usa a menudo al atacar el bajo rayado en aguas poco profundas cerca de la estructura de la costa como muelles, bancos de césped o puntos rocosos.

Aquí hay un desglose de lo que generalmente implica:

Que es:

«Paralelo» se refiere a lanzar su señuelo o cebo paralelo a la costa, en lugar de salir a aguas más profundas.«Puppy» es a menudo un apodo de pequeños plásticos suaves, trajes de baño o enchufes de perfil pequeño, típicamente en el rango de 3 ″ a 5 ″, imitando a los peces de carnada juvenil «.

Esa última oración es interesante porque está completamente mal, no hay estilo de señuelos que sean apodados «cachorros» pero hay una técnica llamada caminar al perro «.

Captura de pantalla de la respuesta incorrecta de Chatgpt

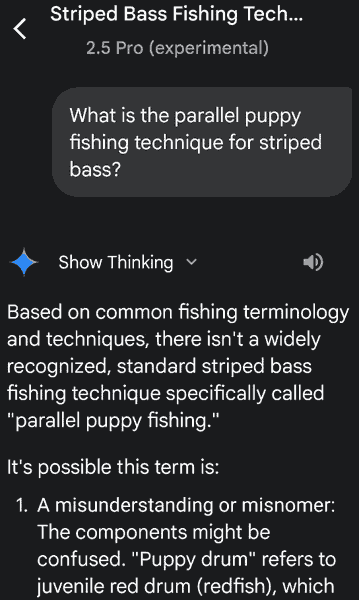

Antrópico Claude

Anthrope Claude, utilizando el último modelo de soneto 3.7, proporcionó una respuesta correcta. Dijo correctamente que no reconoció una «técnica de pesca legítima» con el nombre proporcionado y luego continuó con la presunción de que el usuario quiere aprender tácticas de pesca de lubina a rayas y proporciona una lista de técnicas de las cuales un usuario puede seleccionar un tema como una pregunta de seguimiento.

Captura de pantalla de la respuesta correcta de Claude antrópico

Google Gemini Pro 2.5

Por último, consulté Google Gemini, usando el último modelo Pro 2.5. Gemini también ofreció una respuesta correcta más una salida de árbol de decisión que permite a un usuario decidir:

A. que están malinterpretando las tácticas de pesca

B. Refiriéndose a una táctica altamente localizada

C. está combinando múltiples tácticas de pesca

D. o confundiendo una táctica para otra especie de peces.

Captura de pantalla de la respuesta correcta de Gemini Pro 2.5

Lo interesante de ese árbol de decisión, que se asemeja al enfoque del árbol de decisión en la patente de Google no relacionada, es que esas posibilidades reflejan lo que las descripciones de AI de Google LLM y ChatGPT pueden haber considerado al tratar de responder la pregunta. Ambos pueden haber seleccionado de un árbol de decisión y opción de opción C, que el usuario está combinando tácticas de pesca y basó sus respuestas en eso.

Tanto Claude como Gemini tenían la suficiente confianza para seleccionar la opción E, que el usuario no sabe de qué está hablando y recurra a un árbol de decisión para guiar al usuario a seleccionar la respuesta correcta.

¿Qué significa esto sobre las descripciones de IA (AIO)?

Google anunció recientemente que está implementando Gemini 2.0 para matemáticas avanzadas, codificación y consultas multimodales, pero las alucinaciones en AIO sugieren que el modelo que Google está utilizando para responder consultas de texto puede ser inferior a Gemini 2.5.

Eso es probablemente lo que está sucediendo con consultas de Gibberish y, como dije, ofrece una idea interesante de cómo funciona Google AIO.

Imagen destacada por Shutterstock/Slladkaya